微软AR/VR专利提出改善眼动交互的“误交互”问题

基于生理反馈的制导目标瞄准

(映维网Nweon 2024年09月24日)在一系列的AR/VR计算场景中,用户需要通过瞄准机制来瞄准计算机生成的或真实世界的对象。有时候,用户很难准确地定位感兴趣对象。例如,当两个或多个对象挤在一起或重叠时,用户或会瞄准错误的对象。

在一份专利申请中,微软就提出了一种基于生理反馈的制导目标瞄准。

帮助用户定位正确对象的一种方法是接收来自用户的显式错误反馈。例如,当用户无意中瞄准了错误的对象时,用户可以按下按钮或执行撤销手势来指示说明。然而,这对用户来说是繁重且耗时的,而且往往会削弱用户的信任。

作为替代方案,可以捕获来自用户的隐式错误反馈,例如,当瞄准错误的对象时,用户会下意识地以一种无需用户提供明确反馈即可感知的方式来作出反应。例如,脑电图信号或瞳孔直径的变化等生物信号可以提供用户如何感知计算系统行为的见解。

神经生理反馈通常发生在用户感知到外部刺激后的短时间内。例如,如果用户感知到计算系统错误地瞄准了一个意外对象,则可以在用户意识到错误对象定位后的大约下一秒内捕获用户的生理反应。

微软的发明正是使用用户注意信号来预测用户打算用定位机制定位哪个对象。然后,将预测对象的视觉识别渲染给用户,同时测量用户的反应信号。如果反应信号表明用户感知到错误,则可以修改预测以针对不同的对象。

所以,反应信号作为隐式反馈,允许预测更新,而不必接收来自用户的显式反馈。

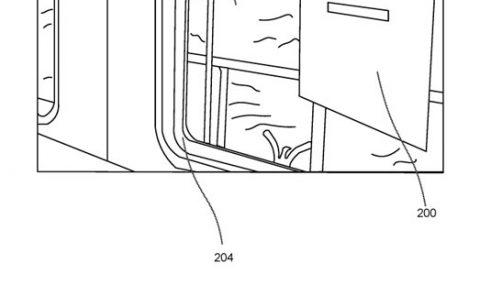

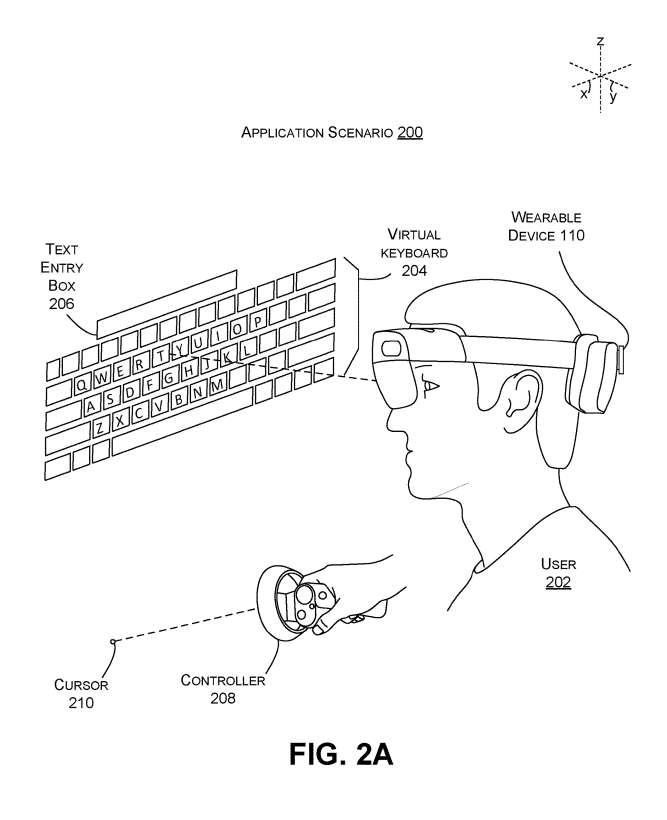

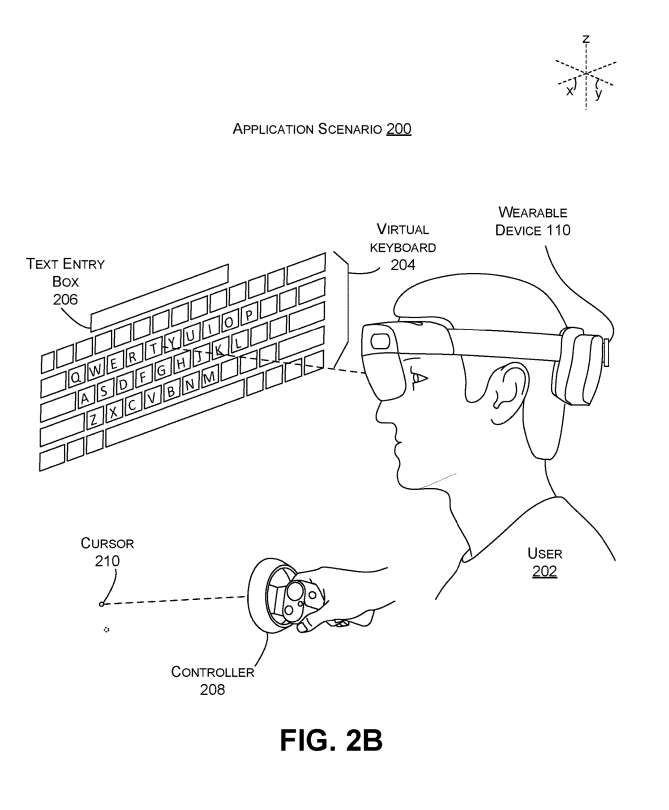

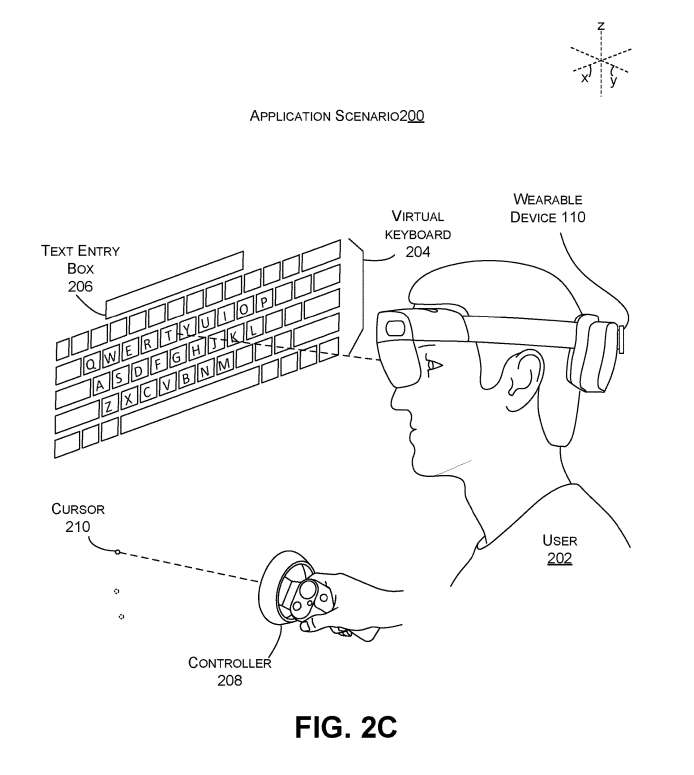

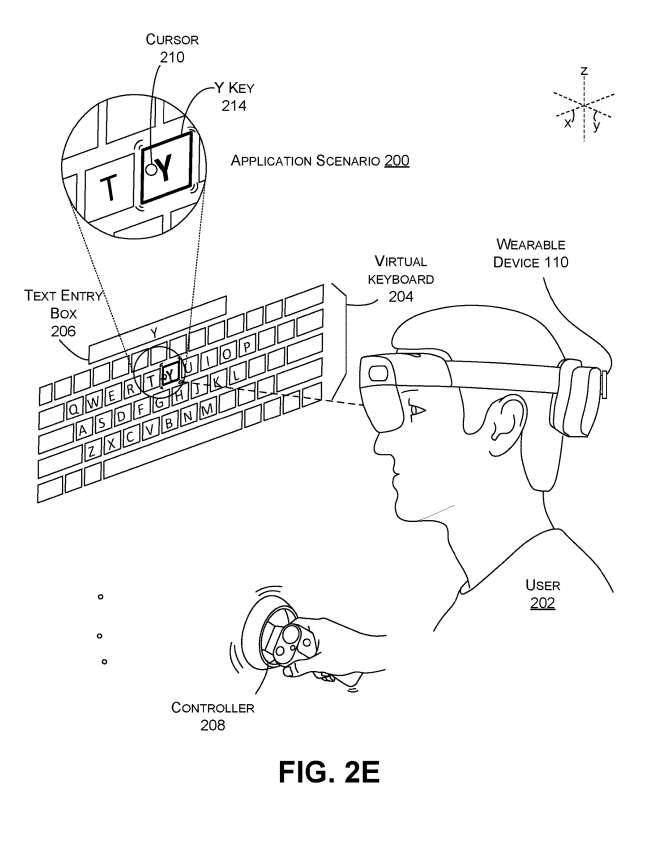

图2A至2E说明了如何通过用户注意信号和用户反应信号来提供预测性目标定位体验。如图2A所示,向佩戴可穿戴设备110的用户202显示虚拟键盘204并用于在文本输入框206中输入文本。用户可以使用控制器208将光标210向虚拟键盘移动。

当用户将光标移向虚拟键盘204时,他们可以用眼睛扫描虚拟键盘的单个字母。当用户扫描时,可以使用一个或多个传感器进行注视追踪,以确定用户的注视方向。

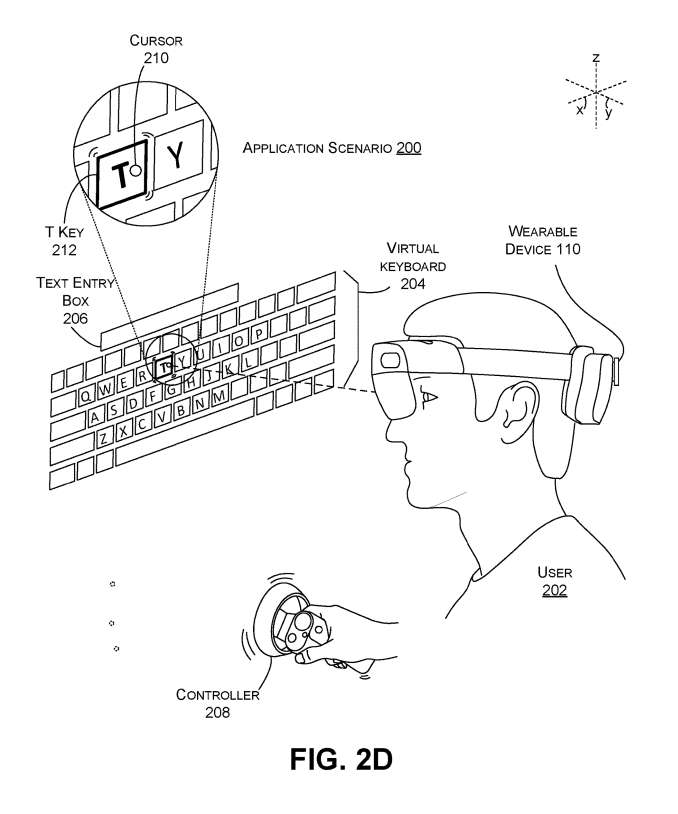

根据用户的注视,可以预测用户想要瞄准的对象。如图2D所示,预测用户打算瞄准T键212。可以提供一个视觉识别,表明用户打算以T键为目标,例如令字母“T”闪烁等等。

另外,可以通过在T键自动移动光标210来执行跳转操作。同时,可以通过控制器208提供触觉反馈,以通知用户已经进行了目标预测。

假设用户实际上是打算瞄准字母Y而不是字母T,则可以接收到指示错误的用户反应信号。这时候,可以将预测对象更新为Y键214,如图2E所示。字母Y可以视觉识别,并且可以再次提供触觉和/或音频反馈,以表明预测的对象已经更新。

当用达他们想要的目标字母时,用户可以执行选择输。然后可以将字母输入到响应选择输入的文本输入框206中。

发明描述可以在广泛的应用场景中使用,以针对许多不同类型的对象。例如,可确定用户打算在体育游戏中向哪个玩家传球,用户是否打算在冒险游戏中射击第一个角色等等。

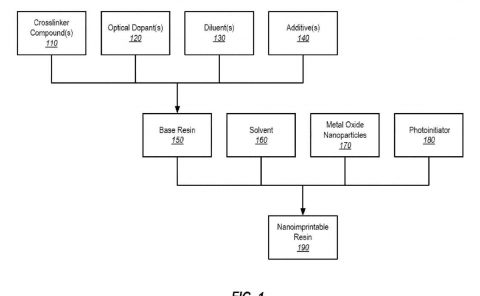

预测用户打算瞄准哪个对象的一种方法是将用户注意力信号映射到多个对象的各自瞄准概率。

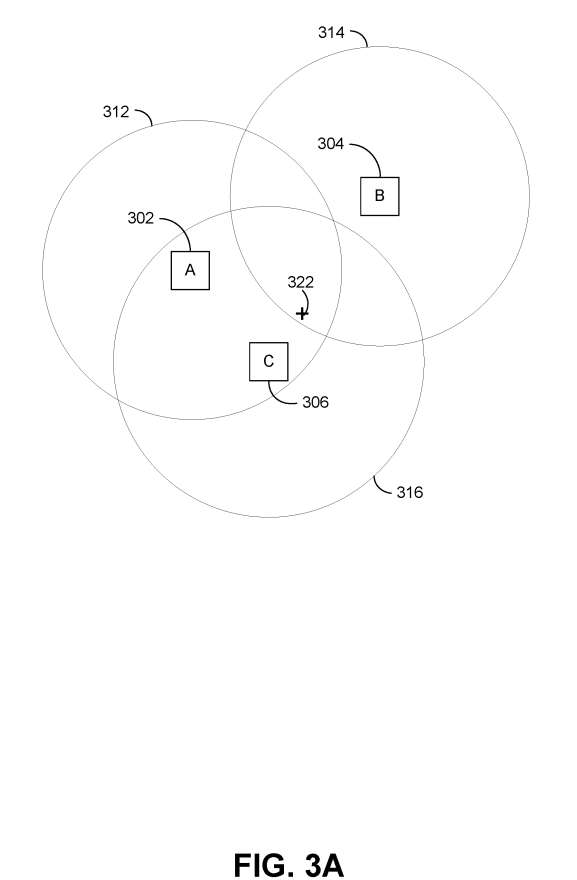

图3A-3C说明了为不同目标分配目标概率的示例技术。具体地说,3A展示了如何将基于注意力的坐标映射到目标概率,其中目标概率与基于注意力的坐标到每个目标中心的距离成正比。

图3A示出对象a302、对象b304和对象c306。出于示例目的,每个对象都显示为一个正方形。如图所示,在对象a周围画圆圈312,在对象B周围画圆圈314,在对象C周围画圆圈316。

图3A示出了可由眼动追踪传感器获得的基于注意力的坐标322。在这里,基于注意力的坐标最靠近对象c306的中心,但同时位于对象a302周围的圆圈312和对象b304周围的圆圈314内。

因此,尽管每个对象都是潜在目标,但对象c是概率最高的目标对象。由于基于注意力的坐标比对象b的中心更接近对象a的中心,所以下一个概率最高的对象是a。例如,给定基于注意力的坐标322,各自的目标概率可能是c 65%,a 25%,b 10%。

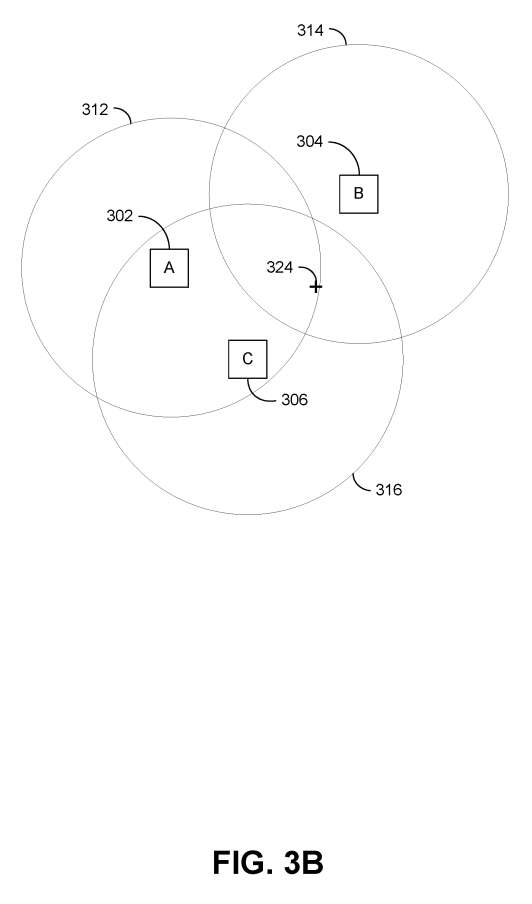

在图3B中,基于注意力的坐标324位于最靠近对象b304的中心,但位于对象a302周围的圆圈312和对象c306周围的圆圈316内。

因此,尽管每个对象都是潜在目标,但对象b是概率最高的目标对象。由于基于注意力的坐标比对象a的中心更接近对象c的中心,所以下一个概率最高的对象是对象c。例如,给定基于注意力的坐标324,各自的目标概率可以是对象b 60%,对象c 30%,对象a 10%。

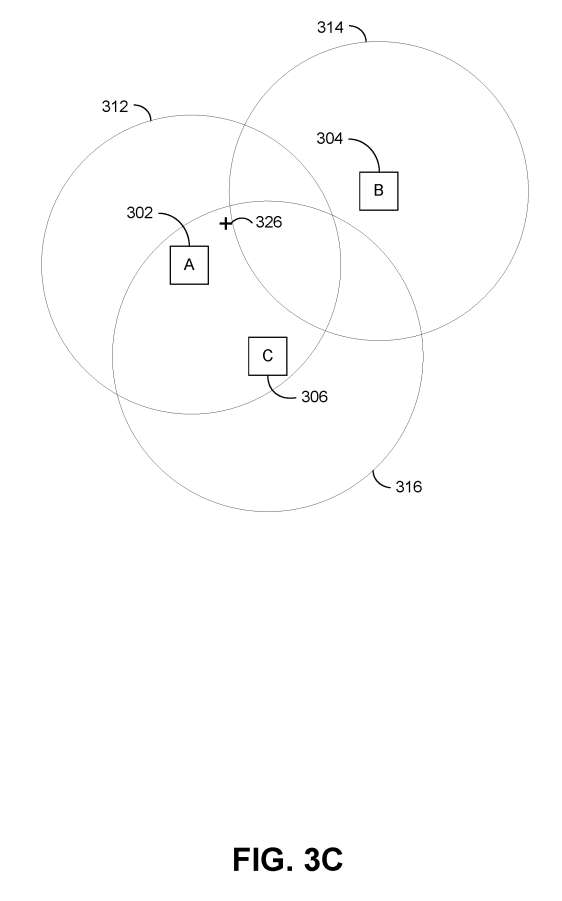

在图3C中,基于注意力的坐标326最靠近对象a302的中心,在对象c306周围的圆圈316内,而在对象b304的圆圈314之外。

因此,对象b可以排除为潜在目标,a是概率最高的目标,其次是c。例如,给定基于注意力的坐标326,各自的目标概率可以是a 90%,c 10%。

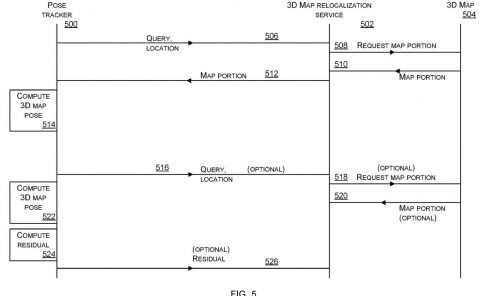

图4示出了用于使用生理反馈的制导目标瞄准的示例方法400,

从402开始,接收用户注意信号。用户注意信号可以传达用户的注意力引导到哪里。例如,用户的注意力信号可以从眼动追踪传感器获得,并可以传达用户的目光所指向的坐标。

在404,使用用户注意信号来识别用户打算用定位机制定位的预测对象。例如参照图2D,预测的对象可以是T键212。

在406,输出预测对象的可视标识。例如,回顾图2D,T键212以粗体显示。视觉识别同时包括使预测对象闪烁、移动、改变颜色、改变大小、显示指向预测对象的箭头等。

在408,接收传达用户对所述预测的生理反应的用户反应信号。例如,用户的反应信号可以从传感器获得,如脑电图传感器,瞳孔直径测量等。

在410,确定所述生理反应是否表明所述用户感知到对所述预测对象的注意力作出响应的错误。识别用户反应信号中的错误的一种方法是确定在用户将注意力转向预测后发生的指定时间窗口是否包含与错误相关的潜力。识别错误的另一种方法包括确定用户的瞳孔直径是否增加超过指定的百分比。

如果用户的生理反应表明错误,方法400返回404,在404中识别另一个预测对象,并再次执行块406和408,直到达到停止条件。

如果用户的生理反应没有指示错误,则方法400继续到412,其中可以对响应选择输入的预测对象执行选择操作。

可以训练各种类型的机器学习框架来执行给定的任务。另外,将用户注视作为用户注意信号只是发明所述的一个例子。在其他实施例中,可以利用EEG或其他传感器信息。

相关专利:Microsoft Patent | Guided object targeting based on physiological feedback

名为“Guided object targeting based on physiological feedback”的微软专利申请最初在2023年3月提交,并在日前由美国专利商标局公布。