微软AR/VR专利探索”眼动+手部追踪“输入交互方式

眼+手追踪

(映维网Nweon 2024年08月12日)对于苹果Vision Pro,最为标志性的一个功能或许是眼+手追踪输入。现根据一份名为“Eye and hand tracking utilizing lensless camera and machine learning”的专利申请,微软同样有在探索手+眼追踪方案。

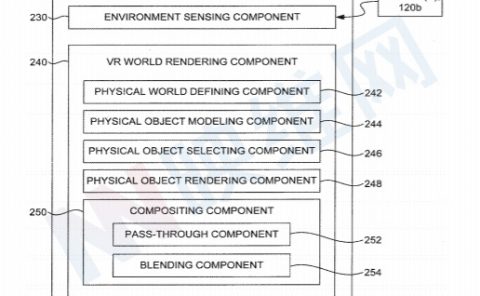

在一个实施例中,头显设备中的眼+手追踪系统配有使用光学掩模作为编码元件的无透镜摄像头系统。其中,编码元件对头显设备用户身体部位(例如眼或手)的光学图像应用卷积。卷积身体图像是由系统中的传感器捕获的编码表示,但非人类可识别。

像神经网络这样的机器学习系统配置为直接从编码表示中提取身体特征,而不需要执行反卷积,。所提取的身体特征由各自的眼或手追踪系统用来输出用户眼或手的相关追踪数据,这些数据可被头显设备用来支持各种应用和用户体验。

在各种说明性示例中,光学掩模由点扩展函数PSF描述,并且可以使用衍射光学元件来实现。折射光学元件如微透镜阵列、透镜或衍射和折射光学元件的组合同样可用于光学掩模。

头显设备中的示例性眼动追踪系统支持朝向无透镜摄像头系统,并包括用于向头显设备用户的眼睛注入漫射照明以产生反射闪光的照明系统,用于应用PSF对反射光进行卷积的光学掩模,以及用于捕获作为编码眼睛特征图的光学掩模输出的传感器。

卷积神经网络等神经网络通过一组编码的眼睛特征进行训练,直接从编码的眼睛特征映射中提取出头显设备用户的眼睛特征来估计注视方向,而无需通过反卷积重建原始眼睛图像。例如,眼睛特征可以包括瞳孔椭圆坐标、瞳孔中心、光照闪烁位置等。

眼动追踪系统的可选特征是配置光学掩膜的PSF,以便在单个图像基础上对来自反射的眼睛特征的深度线索进行编码。传感器捕获的编码眼特征图包括深度线索,神经网络从中提取眼特征的深度估计。深度估计可用于提高眼动追踪的速度和准确性,同时减少稀缺头显设备资源的消耗和/或使应用程序能够实现基于眼动特征深度知识的特征。

头显设备中的示例性手动追踪系统支持朝外无透镜摄像头系统,并包括用于将PSF应用于从用户手部反射的的光的光学掩模,以及将光学掩模的输出捕获为编码手部特征图的传感器。另外,配置一个由编码手特征集训练的神经网络,直接从编码表征中提取手特征,以估计手的位置和/或姿势而无需通过反卷积重建原始手图像。

微软指出,有利的是,无透镜摄像头和机器学习系统提供精确的身体追踪,而且重量轻,结构紧凑,这在寻求重量和体积最小化的头显设备应用中特别有益。

直接从编码表示中提取身体特征,尽管这限制了反卷积的性能,但与传统方法相比,计算量更少。更少的计算可以通过减少延迟来提高身体追踪性能,并且降低功耗,从而提高头显设备的续航。结合无透镜摄像头和机器学习系统的端到端优化可以加速收敛到最佳机器学习参数并降低训练成本。

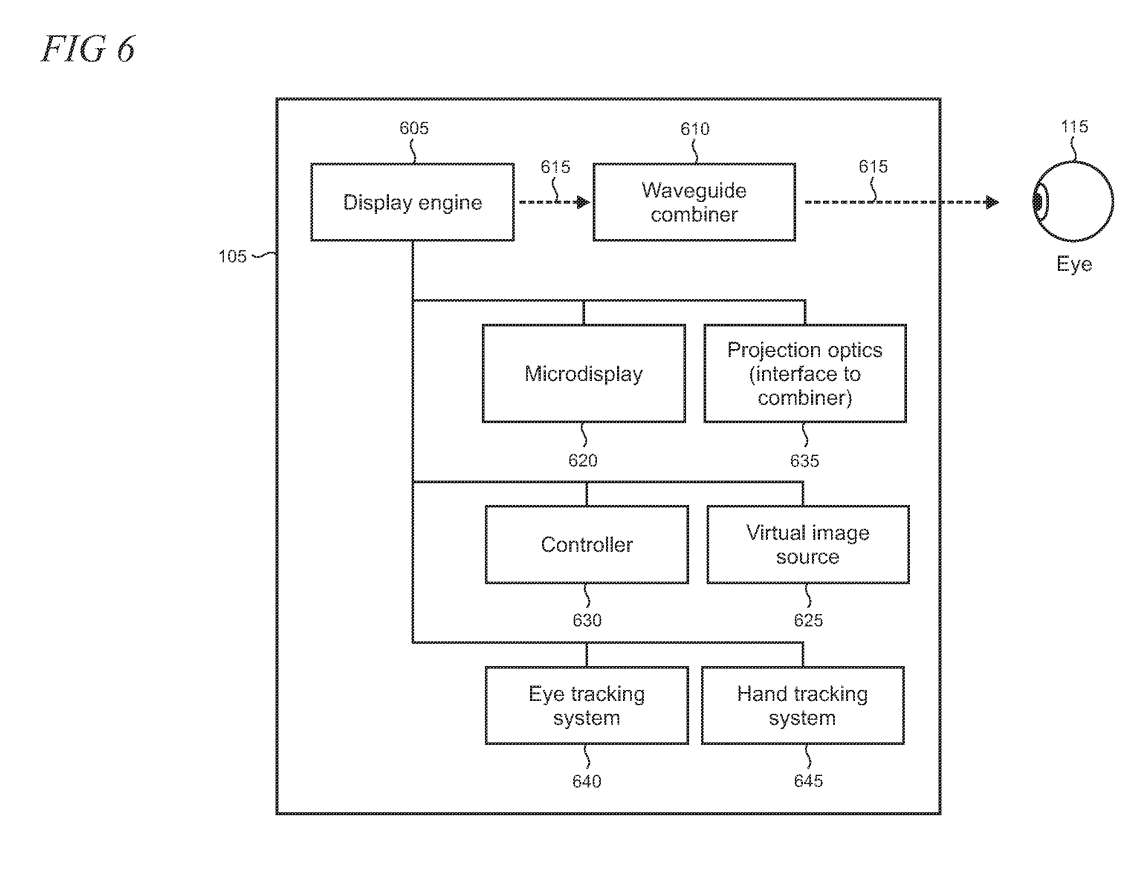

图6显示的头显系统可进一步包括眼动追踪系统640和手动追踪系统645。所述眼动追踪和手动追踪系统中的每一个都可以配置有根据发明原理布置的无透镜摄像头和机器学习系统。

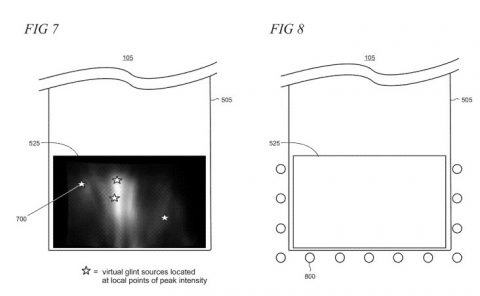

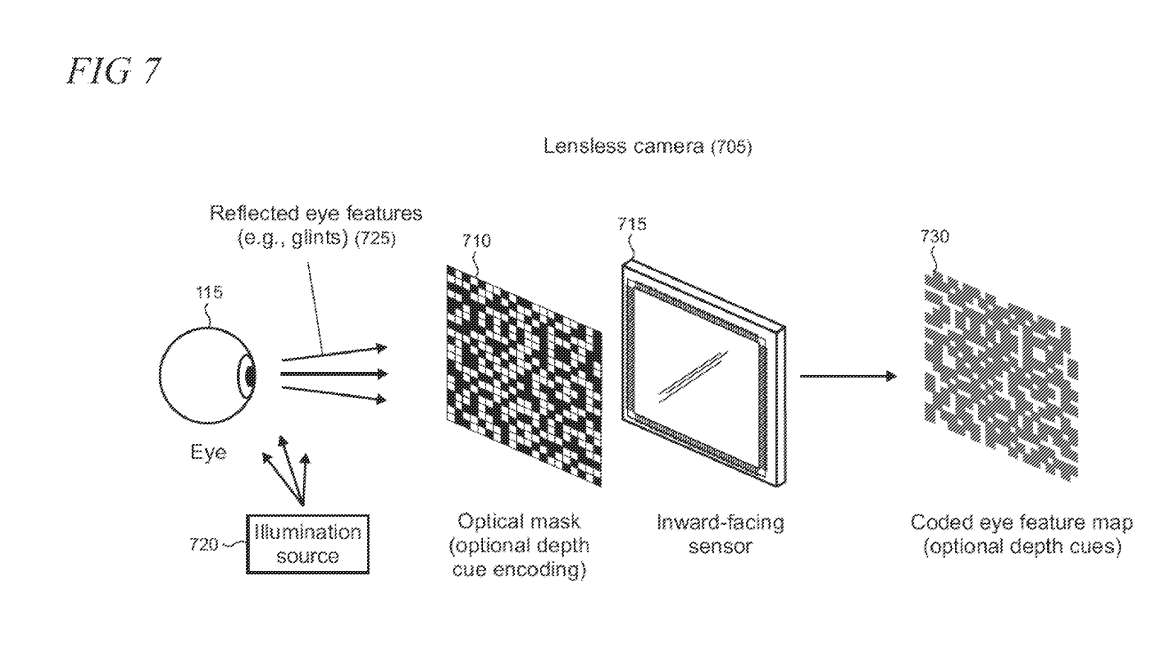

图7示出可用于眼动追踪系统640的无透镜摄像头705。无透镜摄像头包括光学掩模710,其配置为与相邻的内向传感器715互操作。

照明源720配置为例如使用红外IR或近红外波长向眼睛115提供不可见照明。与眼睛特征(相对应的反射光725撞击在所述光学掩模上,所述光学掩模以基于所述掩模结构的空间编码模式控制光的透射率。例如,眼睛特征可以包括瞳孔椭圆坐标、瞳孔中心、光照闪烁位置等。

所述光学掩模710控制透光率,使得所述显示系统105的视场中的每个光角将以与垂直和水平方向上的光角相关的线性移位方式来把相同的图案投影到所述朝内传感器715。因此,传感器捕获的编码数据包括视场内每个角度的阴影的总和。

反射的眼睛特征725由内向传感器715捕获为编码的眼睛特征图730。反射的眼睛特征的变化,例如用户眼球的闪烁和/或用户瞳孔的位置,可以通过使用朝内传感器收集的编码眼睛特征来确定,从而能够在一定程度上用于估计注视方向。

可选实现的特征包括在无透镜摄像头705中配置光学掩模710以从反射的眼睛特征725执行深度线索编码。光学掩模的深度线索编码产生编码的眼特征图,其中包括编码的深度线索,机器学习系统根据该深度线索执行眼特征的深度估计。

光学掩模的深度线索编码和机器学习系统执行的深度估计提供了额外的眼动追踪数据,而它们可以提高某些应用中追踪系统的准确性和鲁棒性,并且为眼动深度数据支持的额外应用功能提供基础。

由于深度估计是在单眼特征图像进行,所以与传统的立体图像对成像和分析等方法相比,这种方法可以更简单、更快、更准确地实现具有深度估计的眼动追踪。因此,单图像深度估计可以降低头显稀缺资源的利用率。

光学掩模710不会像传统透镜那样将反射的眼睛特征725聚焦到朝内传感器。通过无透镜,图7所示的掩模、照明源和传感器的组合可以封装在一个与传统摄像头相比紧凑轻便的形状参数之中。

另外,照明源720可以在泛光照明配置中实现,从而为用户的整个眼睛提供一般漫射照明。这种配置可以取代或最小化在传统眼动追踪系统中使用的结构化照明源。例如,这样的传统系统通常可以在用户眼睛的整个外围使用一组红外LED,以确保在瞳间距离范围内对显示器的视场进行准确而稳健的角膜反射追踪。

与目前的眼动追踪系统相比,来自LED的结构化照明可能会增加额外的体积、重量和设计复杂性,并增加稀缺资源的消耗。

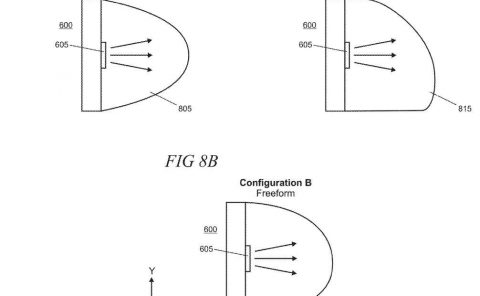

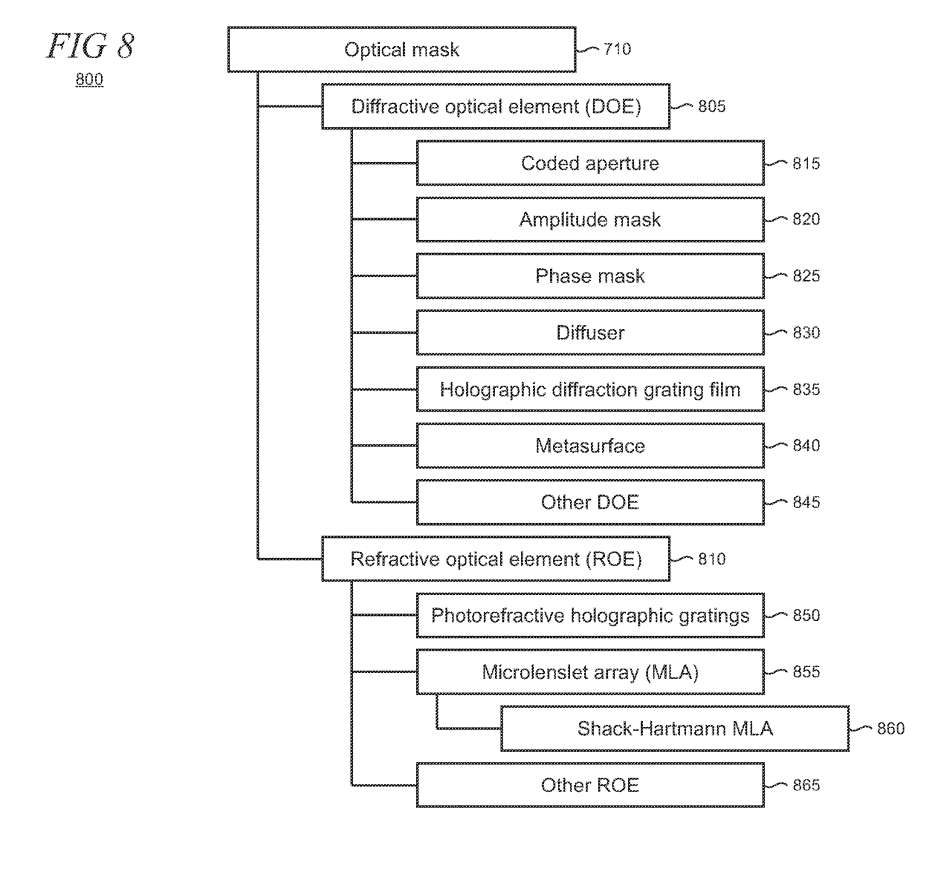

图8示出用于光学掩模710的分类。光学掩模的配置和用于实现它的技术可以根据应用以及发明的特定要求和使用环境而变化。通常,光学掩模可包括衍射光学元件805和折射光学元件810。

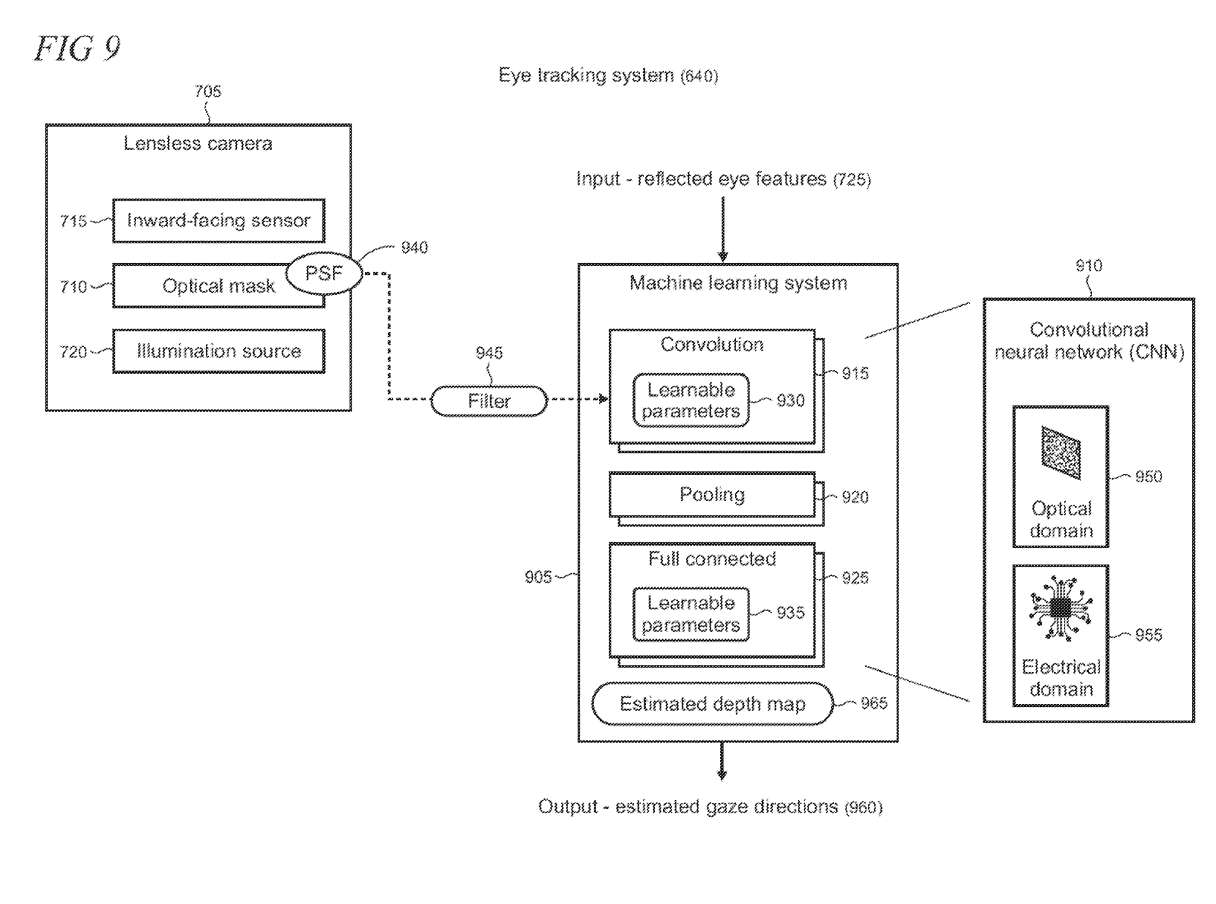

图9显示了根据发明原理布置的眼动追踪系统640,包括无透镜摄像头705和机器学习系统905。机器学习系统包括卷积神经网络CNN 910,后者涵盖卷积层915、池化层920和完全连接层925。

卷积层915和完全连接层925包括各自的可学习参数930和935,它们构成层中的权重矩阵。可以理解,CNN的目标是在训练过程中使用反向传播来学习参数的值。权重矩阵有助于CNN模型的预测能力,并且在反向传播过程中可学习参数发生变化。

在机器学习系统905中,光学掩模710的PSF 940用作CNN 910的第一卷积层915中的滤波器945。因此,CNN包括光域950和电域955。滤波器945与表示光域中反射的眼睛特征725的输入进行卷积,以生成编码的眼睛特征映射。

机器学习系统905从光学掩模710编码的反射眼睛特征中提取眼睛特征到编码的眼睛特征图中,并使用提取的特征提供包括估计注视方向的输出960。在将深度线索编码到眼特征图中的实现中,机器学习系统可以从深度线索生成估计的深度图965。估计的深度图可以用作眼动追踪的附加数据。

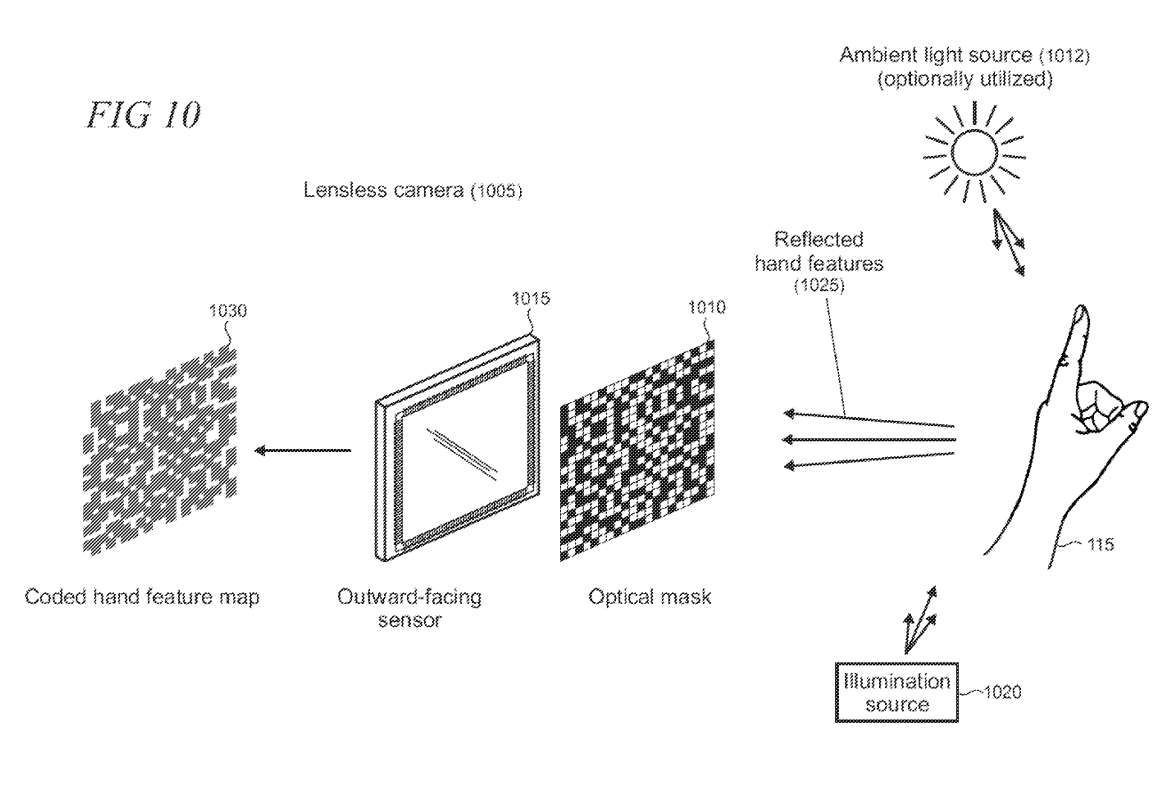

图10示出可用于手部追踪系统645的无透镜摄像头1005。所述无透镜摄像头包括光学掩模1010,其配置为与相邻的外向传感器1015互操作,例如CMOS图像传感器、CCD图像传感器或其他合适的无源或主动像素图像传感器。

照明源1020配置为例如使用红外或近红外波长向用户115的一只或两只手提供不可见的照明。在备选实施方案中,可见波长的环境光1012源可用于替换或补充来自源1020的红外光。

与手部特征相对应的反射光1025击中所述光学掩模,所述光学掩模根据所述掩模结构以空间编码模式控制光的透射率。例如,手的特征可以包括手掌中心、指尖位置、手的方向等。手部特征可由手部追踪系统645利用以创建合适的手部追踪轮廓和模型,例如手部网格、关节模型或手部可视化,从而支持给定混合现实环境中的各种应用和用户体验。

与眼动追踪系统中使用的光学掩模710类似的方式,光学掩模1010配置为控制反射手特征的透射率,使得显示系统的视场中的每个光角将以与垂直和水平方向上的光角相关的线性移位方式来把相同的图案阴影到朝外传感器1015。

因此,在传感器捕获的编码手特征数据包括视场内每个角度的阴影的总和。反射的手特征1025由朝外传感器1015捕获为编码的手特征图1030。提取反射手特征的变化并利用其进行手部追踪。

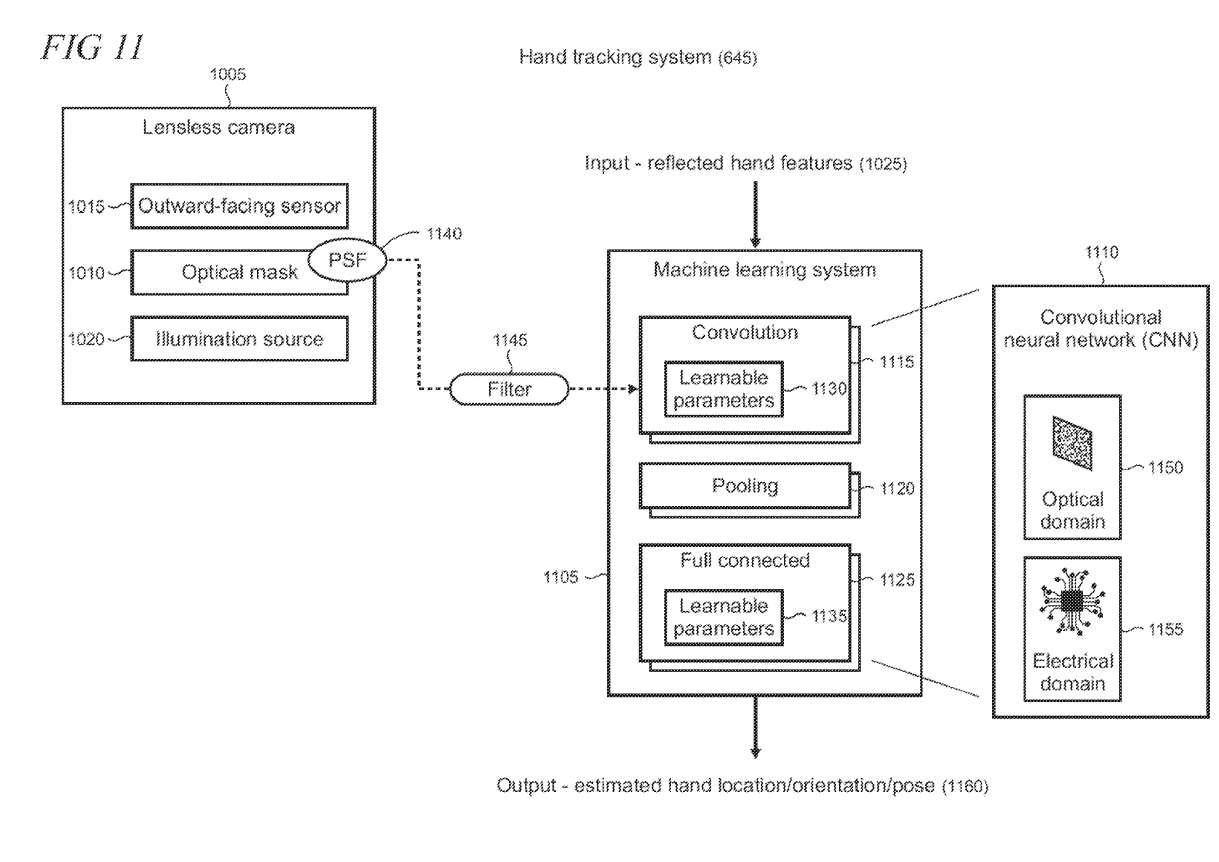

图11示出了根据发明原理布置的说明性手部追踪系统645,系统包括无透镜摄像头1005和机器学习系统1105。在这个说明性示例中,机器学习系统包括一个卷积神经网络CNN 1110,其层包括卷积层1115、池化层1120和完全连接层1125的实例。卷积层1115和完全连接层1125包括各自的可学习参数1130和1135,其构成层中的权矩阵。

根据发明,在包括光学和电域1150和1155的机器学习系统1105中,光学掩模1010的PSF 1140用作CNN 1110的第一卷积层1115中的滤波器1145。滤波器1145与表示光域中反射的手部特征1025的输入进行卷积,以生成编码的手部特征映射。

机器学习系统1105从光学掩模1010编码的反射手特征中提取手特征到编码的手特征图中。机器学习系统使用提取的特征来提供输出1160,包括例如估计的手部位置、方向、姿势等。

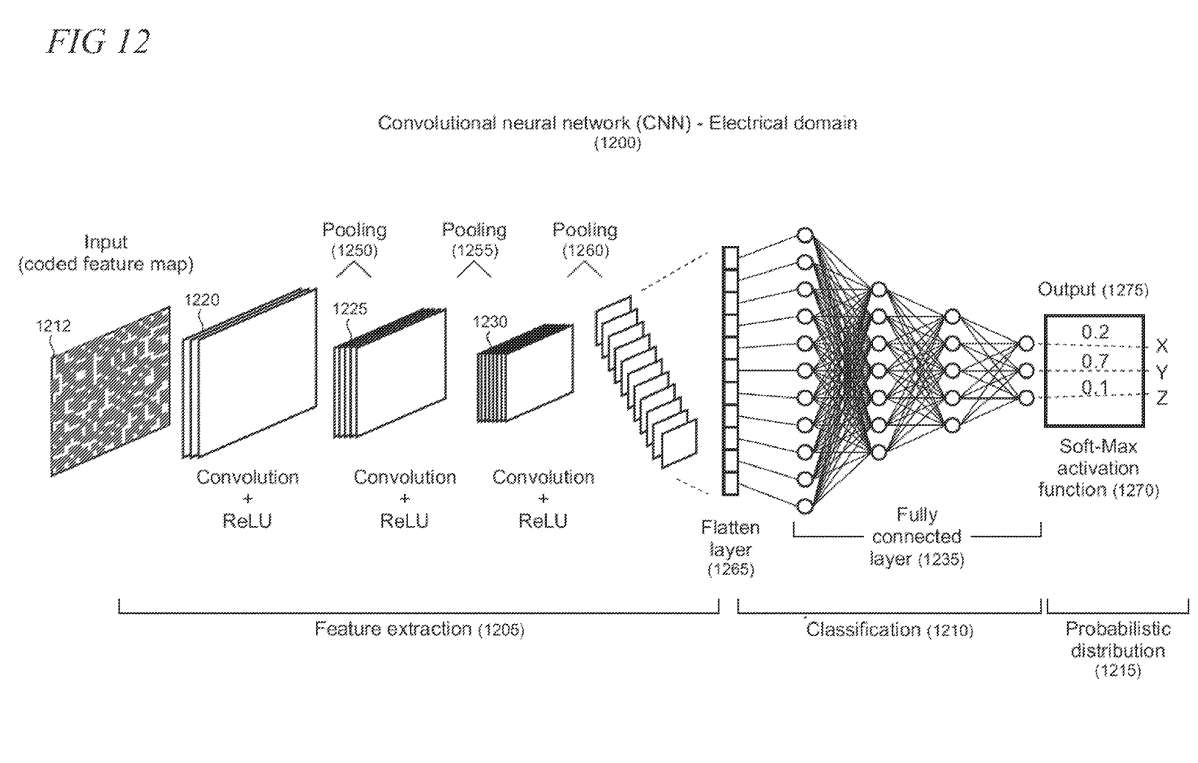

图12示出CNN的说明性电域部分1200。这个说明性示例使用了三个卷积层1220、1225和1230以及一个完全连接层1235。卷积层从输入中识别和提取特征和模式,并将信息保存在矩阵中。输入的矩阵表示与过滤器按元素相乘,并求和以产生特征矩阵。在这个示例中,每个卷积层包括一个ReLU层,它在执行卷积后计算ReLU激活函数,使CNN能够解释非线性关系。

池化层1250、1255和1260周期性地位于连续的卷积层之间。池化层对每个特征矩阵进行独立操作,以降低其空间分辨率,同时保留分类所需的矩阵特征。池化通常包括最大池化和平均池化。池化逐渐减小了矩阵的空间大小,减少了CNN网络中的参数数量和计算量,并且可以控制神经网络模型与训练数据完全拟合的过拟合。

在给定的CNN中可以有多个卷积、ReLU和池化层的实例。卷积的初始层学习一般信息,下游层学习更具体/复杂的特征。在最后的卷积层、ReLU层和池化层之后,输出特征矩阵在flatten层1265中转换为向量。来自平化层的输出馈送到完全连接层1235。

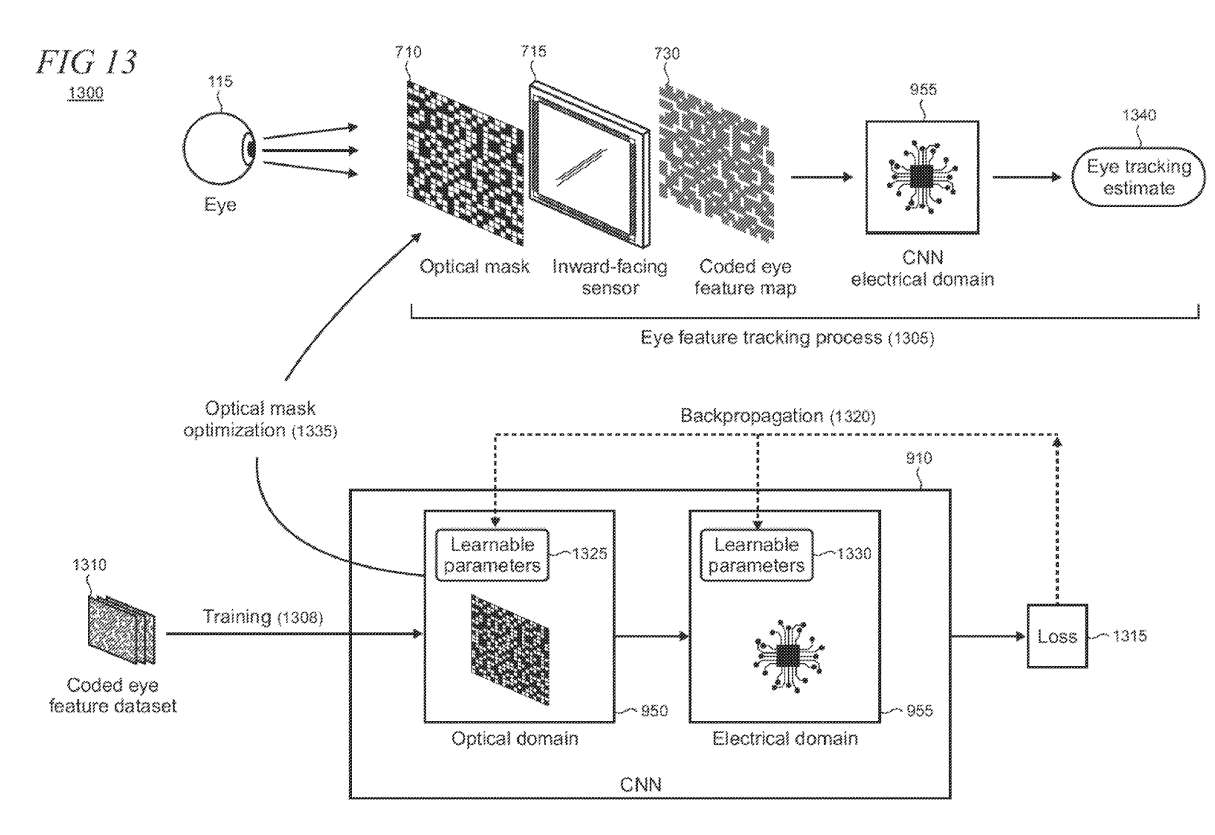

图13示出用于在光学和电气领域共同优化CNN组件的说明性布置1300。设备包括CNN 910和眼特征追踪模型1305。CNN包括光学域950,其中使用光学掩模710实现光学卷积模型,以及完成眼睛特征提取和注视方向估计处理的电域955。

在使用编码的眼睛特征数据集1310进行训练期间,使用损失函数1315来衡量CNN 910对提取的眼睛特征进行分类的性能。训练数据集可能包括可选实现中的编码深度线索。利用反向传播1320来调整光域和电域950和955中各自的可学习参数1325和1330,通过计算其梯度来最小化损失函数。可学习参数包括光域中的卷积滤波器和电域中的层权值。

反向传播依赖于微积分的链式法则,通过神经网络的层向后计算梯度。使用梯度下降,对可学习参数的迭代调整使运动更接近最小损失函数值,通过在梯度给定的方向上小步移动。

CNN组件联合优化的结果使得光学掩模优化能够在光学域实现。例如,可以修改光学掩模710的透光模式以实现PSF,PSF使用在训练期间对来自反向传播的可学习参数的调整进行调谐。当在眼动追踪过程中使用修正后的光学掩模和调整后的CNN层权重时,与未优化的过程相比,可以提供精度更高的眼动追踪估计1340。

相关专利:Microsoft Patent | Eye and hand tracking utilizing lensless camera and machine learning

名为“Eye and hand tracking utilizing lensless camera and machine learning”的微软专利申请最初在2023年10月提交,并在日前由美国专利商标局公布。

需要注意的是,一般来说,美国专利申请接收审查后,自申请日或优先权日起18个月自动公布或根据申请人要求在申请日起18个月内进行公开。注意,专利申请公开不代表专利获批。在专利申请后,美国专利商标局需要进行实际审查,时间可能在1年至3年不等。

另外,这只是一份专利申请,不代表一定通过,同时不确定是否会实际商用及实际的应用效果。